Conheça o inovador Spatial Speech Translation, que permite entender diversas pessoas falando idiomas diferentes ao mesmo tempo com precisão e realismo sonoro

A nova tecnologia apresentada no Japão transforma os encontros entre diferentes idiomas. A MIT Technology Review divulgou detalhes sobre um modelo que combina inteligência artificial com captação de som espacial.

Um desenvolvimento recentemente apresentado na conferência ACM CHI em Yokohama (Japão) promete transformar radicalmente a forma como as pessoas interagem em ambientes multilíngues. Diante do surgimento dessa nova tecnologia, a MIT Technology Review revelou mais informações.

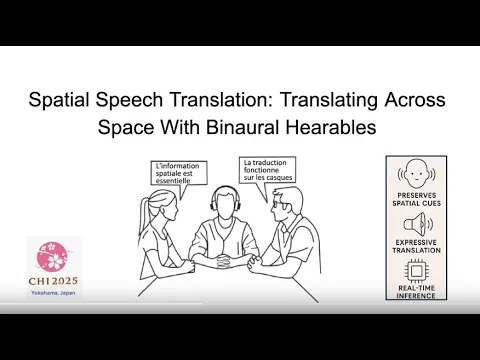

Trata-se do Spatial Speech Translation, um sistema de tradução simultânea baseado em inteligência artificial que permite aos usuários de fones de ouvido identificar e compreender o que várias pessoas dizem ao mesmo tempo — mesmo que falem idiomas diferentes.

-

MZKT-79221: o mega-caminhão russo que carrega o míssil RS-24 Yars em temperaturas de até -50 °C, com 16 rodas, tração total e capacidade para 80 toneladas

-

Ele superou Fusca, Hilux e Civic: o carro mais vendido do mundo é japonês, já a de 50 milhões de unidades e é sucesso também entre os brasileiros

-

Esse estudante criou a solução para os engarrafamentos: um carro anfíbio, compacto e sustentável, capaz de atravessar rios

-

Arqueólogos encontram na Amazônia vestígios de uma civilização perdida com 2.500 anos e infraestrutura avançada, incluindo estradas interligadas e áreas de habitação

Projetado para funcionar com fones de ouvido convencionais com cancelamento de ruído, o sistema não apenas traduz, mas também reproduz a voz traduzida com um timbre e direção espacial que imita a pessoa original, gerando uma experiência de conversa mais natural e contextualizada.

Um sistema contra a barreira do idioma em grupos

O objetivo do Spatial Speech Translation é enfrentar um dos desafios mais complexos para os sistemas automáticos de tradução: a sobreposição de vozes em conversas em grupo.

Com essa tecnologia, a inteligência artificial é usada para rastrear tanto a origem espacial do som quanto as características individuais de cada voz, o que permite ao usuário identificar com precisão quem está falando e o que está sendo dito.

A proposta vai além de uma simples tradução simultânea. Segundo a descrição técnica, o modelo divide o ambiente acústico do usuário em pequenas regiões e analisa cada uma delas para detectar possíveis interlocutores.

Esse reconhecimento possibilita gerar uma versão traduzida de cada voz que preserva elementos essenciais como a direção do som, o tom emocional e o timbre original — resultando em uma experiência auditiva mais realista.

A dimensão pessoal por trás do projeto

A iniciativa tem uma motivação profundamente pessoal para um de seus idealizadores, o professor Shyam Gollakota, pesquisador da Universidade de Washington. Em declarações compartilhadas com a MIT Technology Review, Gollakota explicou: “Acreditamos que este sistema pode ser transformador”.

A partir de uma perspectiva humanista, defende-se que a tecnologia não deve apenas facilitar a comunicação, mas também promover maior inclusão social para pessoas que enfrentam barreiras linguísticas.

Mais do que resolver casos específicos, o projeto visa reduzir a ansiedade e o isolamento que muitos sentem ao não conseguir participar plenamente de uma conversa por não dominar o idioma.

Inteligência artificial em dois níveis: como funciona

O sistema é composto por dois modelos interdependentes. O primeiro analisa o espaço sonoro com uma rede neural que divide o ambiente em pequenas zonas. A partir dessa segmentação, ele localiza a direção exata de onde vêm as vozes.

O segundo modelo processa as vozes detectadas, as traduz para o inglês a partir de três idiomas — francês, alemão e espanhol — e reconstrói uma versão da voz original, replicando elementos como tom, volume e cadência emocional.

O aspecto inovador está no fato de que essa “voz clonada” mantém um alto grau de naturalidade. Em vez de uma tradução robótica, a pessoa que usa os fones de ouvido ouve uma versão sintetizada que emula a voz do falante original, com uma latência de apenas alguns segundos. Essa característica permite uma dinâmica de conversa mais fluida do que os sistemas convencionais.

Diferenças em relação às tecnologias existentes

Diferente de outros dispositivos com tradução automática — como os óculos inteligentes da Meta —, o Spatial Speech Translation foi desenvolvido para processar múltiplas vozes simultaneamente. Enquanto a maioria dos sistemas atuais se concentra em um único interlocutor, essa proposta busca resolver o problema real de conversas em grupo, com sobreposição de vozes e idiomas.

Além disso, a tecnologia utiliza hardware ível: fones com microfones embutidos e laptops com chips Apple M2, que possibilitam a execução dos modelos de redes neurais. Essa compatibilidade com tecnologias disponíveis no mercado favorece uma possível adoção em larga escala.

Desafios e próximos os

Um dos principais desafios enfrentados pela equipe é reduzir a latência entre a fala e sua tradução. Atualmente, o atraso é de alguns segundos, o que afeta a fluidez da conversa. “Queremos reduzir significativamente essa latência para menos de um segundo, de modo a manter o ritmo da conversação”, explicou Gollakota.

Esse objetivo apresenta dificuldades técnicas complexas, já que a estrutura sintática de cada idioma influencia a velocidade da tradução. Por exemplo, o sistema é mais rápido ao traduzir do francês para o inglês, seguido do espanhol e, por fim, do alemão.

Segundo o pesquisador Claudio Fantinuoli, da Universidade Johannes Gutenberg de Mainz, isso ocorre porque o alemão costuma posicionar os verbos — e, portanto, grande parte do significado — no final das frases.

Vários especialistas que não participaram do desenvolvimento elogiaram o avanço. Samuele Cornell, pesquisador do Instituto de Tecnologias da Linguagem da Carnegie Mellon, destacou que o projeto é tecnicamente impressionante, mas alertou que, para sua aplicação em massa, será necessário mais treinamento com dados reais e gravações em ambientes ruidosos.